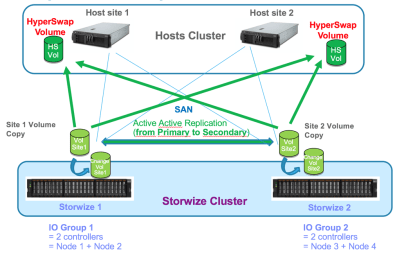

HyperSwap Yapısı Kurulumu:

Neye ihtiyacımız var?

- Cluster IP Address (1x)

- Service IP Address (for each Node)

- Netmask

- Gateway

- Contact Details

- License

- Date and Time or NTP Server IP Address

- Email Server

Yukarıda görselde gördüğünüz gibi storage arka tarafında üzerinde T yazan technical porta RJ-45 kablosuyla bilgisayarımızı bağlıyoruz.

192.168.0.1 default adresine bir tarayıcı üzerinden açıp aşağıdaki görsellerdeki kurulum adımlarını ilerletiyoruz.

Mevcut bir yapıya eklemek değil, yeni bir HyperSwap yapısı kurmak istediğimizden “as the first node of a new system” kısmını seçip ilerliyoruz.

IP adresi, subnet, gateway bilgilerini girip, işlem tamamlanınca pencereyi kapatabiliriz, 10dk kadar süren reboot süresini bekleyip, technical port dışındaki ethernet portlarından biri ile LAN ağımıza bağlayıp, verdiğimiz IP adresi üzerinden erişebiliriz.

Bağlandığınızda sizi karşılayan GUI üzerinden yeni şifre tanımlayıp, arayüze giriş yapabilirsiniz. Gelen adımları takip edip, isim, lisans, tarih, email server gibi bilgileri tamamlayıp storage kurulumunu tamamlıyoruz.

IBM donanım ürünlerinin tamamının lisanslaması etik lisans modelidir.

İkinci storage’ı eklemek için ilk cihazdaki adımları yapmıyoruz, SAN zoning tamamlandığında görseldeki boş kutucuk görünecektir, buradan ikinci enclosure’yi ekliyoruz.

Bu adımlar sonucunda 2 ayrı IO gruptan oluşan iki ayrı enclosure kurulumunu tamamladık.

Bu IO grupları arayüzdeki “actions” kısmında bulunan “modify system topolgy” kısmına tıklayarak ve gerekli adımları izleyip HyperSwap yapıya geçiriyoruz.

Son olarak HyperSwap yapısını anlattığım yazıda bahsettiğim gibi “split brain”i engelleyen, artık bir java app olarak bir sanal makinaya da kurulabilen Quorum yapısını, 3. bir site a kuruyoruz. Bu app i GUI üzerinde system sekmesi altındaki IP Quorum kısmından görseldeki gibi indirebiliriz.

Quorum kurulumunun ardından HyperSwap topolojide oluşturulmuş yapımızın kurulumu tamamlandı.

HyperSwap yapısında volume leri oluşturup kullanmaya başlayabilirsiniz 🙂

Burak Sefa Alpsoy